编者按:本文来自微信公众号硅星人Pro(ID:Si-Planet),作者:张潇雪、王兆洋,创业邦经授权转载。

满世界都是GPT-4们

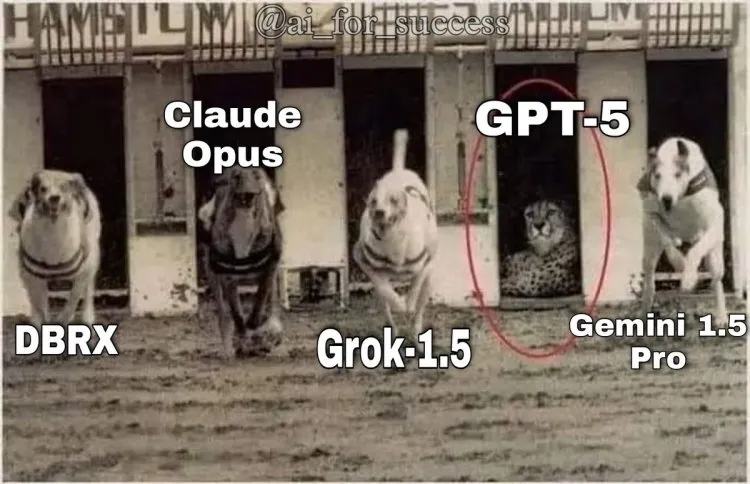

GPT-4问世一年后,全世界已经到处都是GPT-4级别的大模型了。

尤其是最近几个月,这些模型以越发密集的频率现身。

最近的一个就在刚刚。在Google Cloud Next 24大会上,Google把今年二月发布的对标GPT-4的Gemini 1.5系列,进一步开放给用户。Google 宣布,在经过两个月的小范围公测后,Gemini 1.5 pro通过API方式已经对180多个国家和地区开放,并且在其对标GPT-4的性能表现之外,此次Gemini 1.5 Pro还增加了强大的音频理解能力,可以根据用户输入的文本提示,理解、总结上传的视频、音频内容——过往你需要把音频等转成文字,而现在这一步可以省去了。

此外Gemini 1.5 pro还增加了系统指令、JSON模式以及函数调用优化等。

在此次Google云的场子上,Gemini 1.5 pro的能力提升还伴随着一系列从芯片到系统的全面解决方案,Google正加紧跟GPT-4抢生意的步伐。

而不只是Google,同一天,Grok 2.0的消息也传出。据报道,马斯克在一次采访中透露,自己的人工智能威廉希尔中文官网 xAI正在2万张H100上训练Grok 2.0,并将于5月份推出。而且,他相信新版本不仅比GPT-4更强大,还将超越市面上所有大模型标准。甚至扬言训练Grok 3会用到10万张H100 GPU,到时就算GPT-5也会被秒成渣渣。

这还没完。

似乎是还嫌这世界上的“GPT-4们”不够多,据The Information前一天的消息,Meta也计划于下周推出Llama 3的两个小版本,作为夏天发布最大版本的前奏。

而与大模型相比,小型模型通常更便宜、运行速度更快,对于构建移动设备AI软件很有实用价值。去年7月发布的Llama 2-7b、Llama 2-13b和Llama 2-70b因其免费开源而广受社区欢迎,而今两个小版本Llama 3的消息也将振奋开发者情绪。扎克伯格年初宣布35万张H100即将入荷,正在积极训练Llama 3,看来很快就要兑现。据Meta 称,Llama 3 完全版将是多模态的,可能会超过1400亿个训练参数,并希望它真正成为“开源版GPT-4”。

再加上今年2月对标GPT-4的Mistral Large,推理速度、MMLU等关键性能上媲美GPT-4;上月底“开源新王”Databricks发布的号称比Llama 2、Mistral和Grok 1更强的DBRX;以及更令人印象深刻的Anthropic的Claude 3......

全世界到处都是GPT-4了。

GPT-4的瓶颈意味着什么

2022年11月30日,OpenAI 首次发布了由 GPT-3.5 模型驱动的ChatGPT,之后一切都彻底改变。

在ChatGPT首次发布四个月后,2023年3月14日,OpenAI正式推出了GPT-4,后续不断改进,引入多模态能力、增加实时搜索、拉长上下文、重新定义开发者….OpenAI几乎引领了生成式AI所有的技术革新,GPT-4也成为最领先的模型。

所以,如果从OpenAI和ChatGPT的公开发布节奏来算,GPT-3.5的领先只持续了不到6个月,就被GPT-4取代,然而GPT-4作为最强模型却已经持续了一年多。同时,同样水平的模型开始显得“到处都是”。

对于其他行业来说,这已经是个日新月异的疯狂节奏,但拿大模型的进步速度来看,这却给人一种感觉,就是大模型似乎进入了一个瓶颈期。

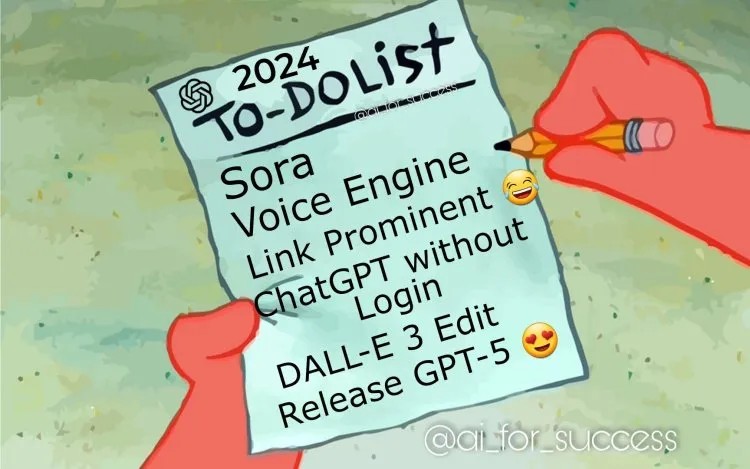

OpenAI也一定会焦虑,但它拿出的似乎只是更多的GPT-5的传言和一个GPT-4 Turbo的正式版。

在Google 用Gemini 1.5 pro的升级和放量针对OpenAI的同时,OpenAI也做了应对,宣布GPT-4 Turbo不再只是以预览版提供给开发者,而是发布了正式版。它自带读图能力不再需要调用GPT-4V接口,训练数据更新到了2023年底。与GPT-4普通版支持8K上下文相比,它能支持128k上下文。

尽管OpenAI官方对此形容为模型能力“大范围提升”,但外界期待的显然不是这个。

那么这种看起来越来越可能的瓶颈期对行业意味着什么?

对于对AGI快速到来满怀期待的人们来说,这显得很糟糕。但其实对期待生态和商业机会爆发的人们来说,瓶颈可能不是个“坏事”。这意味着底层模型能力和技术路线的颠覆频率变的没那么疯狂,建立在上面的应用和中间层都可以有更高的确定性。

同时,对于那些真正的大客户来说,他们也可以不再“等等看”——当底层能力每几周就突破一次的时候,账期动辄好几个月的产业侧客户们自然会选择持续观望而不是马上拨动预算。而当他们看到技术似乎稳定下来,情况就会变化。

而对于Sam Altman来说,他正在面对又一个全新的局面。

GPT-4作为最强模型的时间越久,就越可能有更多的对手追上来,但追上来的对手似乎又都没有达到像GPT-4对GPT-3.5那样的超越。那么,他过往一段时间领导OpenAI在执行的策略——依靠技术路线的领先来更早的拿到最多的商业化订单和融到更多的钱,然后反哺研发,延续Scaling law,继续保持代际领先的路线,就可能不再成立。

当对手一次次的跟上,用户们一次次的喊着GPT-5就要来了但又一次次没来的时候,OpenAI正变得不再独特,这家公司需要Sam Altman去做的,就越来越像一个科技公司大厂CEO要做的事情,去一个差异化不大的市场里比拼最基本的商业竞争能力——当外面到处都是GPT-4,Sam Altman的那些高调打法,可能就要“收手”了。

本文为专栏作者授权创业邦发表,版权归原作者所有。文章系作者个人观点,不代表创业邦立场,转载请联系原作者。如有任何疑问,请联系editor@cyzone.cn。